一文解析自动驾驶系统中的不确定性感知场景

ADS主要是由高速场景向城市道路场景演进来落地领航辅助NOA功能。随着车辆传感器等高性能硬件配置增加、大算力平台的构建、以及AI算法的泛化能力提升,NOA全场景的落地节奏在明显加快。AI与场景的深度融合,推动ADS逐步实现从低速到高速,从载物到载人,从商用到民用,从阶段一提供L2高级辅助驾驶和L3拥堵高速公路副驾驶,发展到阶段二可以提供L3拥堵公路自动驾驶和L4高速公路自动驾驶,最终实现阶段三的L4城郊与市区自动驾驶和L5商用无人驾驶。然而大量的分析表明,目前在很大的程度上自动驾驶车或者无人驾驶AVs的安全性能估计比人类驾驶明显要差一个数量级,虽然可以适应仿真和简单低遮挡的约束真实场景,但仍难以应对城市的复杂道路交通场景,包括恶劣天气环境,定位信号缺失,目标高度遮挡,有限全局视野,人车交互,车车交互,以及小尺寸目标或干扰目标等。场景动态适应能力问题,即所谓“Long-Tail Challenge” 长尾挑战,依旧是ADS当前待解决的主要难题之一。AVs使用体验数据显示,在暴风雨雪天气,车辆的控制由于打滑和oversteering等原因,目前是远低于用户期望的。

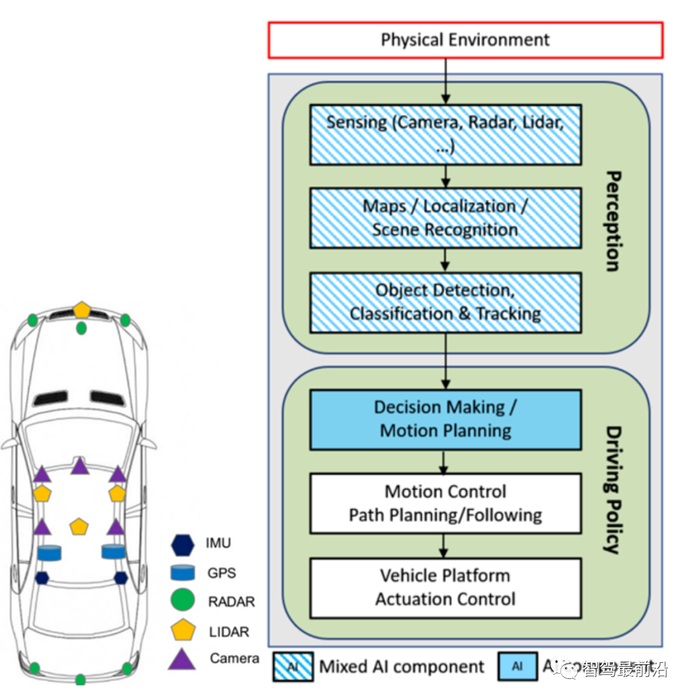

ADS算法的典型系统分层架构如图1所示,一般包括传感层,感知层,定位层,决策层和控制层。每个层面采用传统算法模型或者是与深度学习DNN模型相结合,从而实现ADS全程驾驶的人类可以接受的高可靠和高安全性,以及在这个基础上提供最佳能耗比、最佳用车体验、和用户社交娱乐等基本功能。

ADS传感层的不确定性挑战

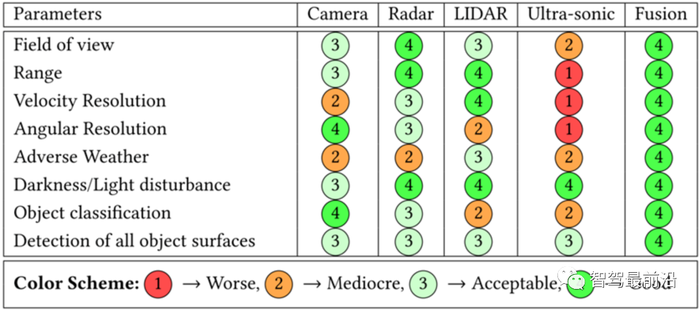

如图2所示,ADS部署的传感器在极端恶劣场景(雨雪雾、低照度、高度遮挡、传感器部分失效、主动或被动场景攻击等)的影响程度是不一样的。所以传感器组合应用可以来解决单传感器的感知能力不足问题,常用的几种组合是:Camera+LIDAR; Radar(3D, 4D)+Camera+LIDAR(LD, HD);Radar+Camera。统计数据表明Radar+Camera是最常见组合。ADS传感层总结如下:

Camera:可以提供360环视和远距前后视角的环境语义表征,但需要一个照明环境,单目和多目Camera可以提供一定程度的目标深度信息;受恶劣场景影响严重;镜头脏污会严重影响图像质量。

LIDAR:可以提供场景的空间信息;但难以检测有反光效应的或者透明的物体;当雨速高于40 mm/hr 到95 mm/hr,信号反射密度严重损失并产生雨枕现象;大雪天气下可视距离缩短并产生反射干扰波形;浓雾场景会产生鬼影现象;温差会产生额外时间延迟。

Radar:对周围车辆检测准确率高,可以提供目标的速度信息,4D Radar还可以提供目标高度的可靠信息;不适合做小目标检测;大雨浓雾和暴风雪会产生接收信号强衰减和斑点噪声,总体对环境的适应性高。

ADS感知层的不确定性挑战

ADS感知层的主要应用场景包括高速公路,城郊与市区道路;十字路口,交通环岛,潮汐公路;隧道,停车场等,其主要任务是基于多模的2D/3D人车物目标识别,动态目标跟踪与速度识别,交通标志识别,车道线识别,红绿灯识别,路面可行驶区域语义分割,路面障碍检测,盲区检测,交通事件检测,司机打瞌睡检测等。与此对应的核心产品特性包括:碰撞预警,紧急刹车,车道偏离预警,传感部分失效预警;车道变道,车道并道,路口通行,行为预测,轨迹预测,轨迹规划;车速控制,转向控制等等。

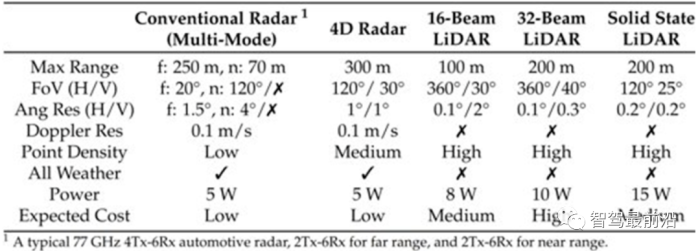

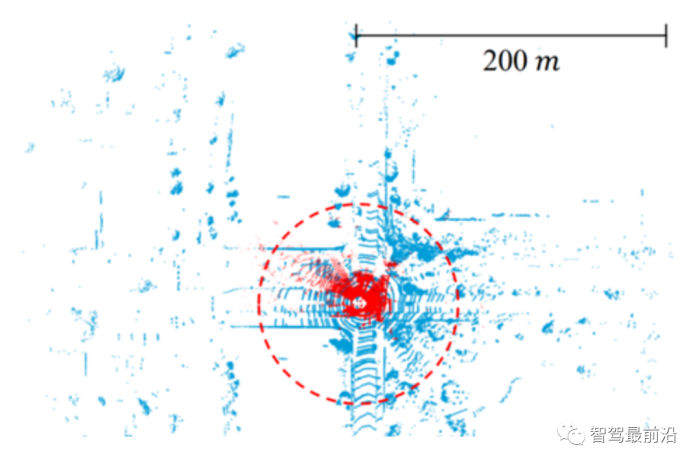

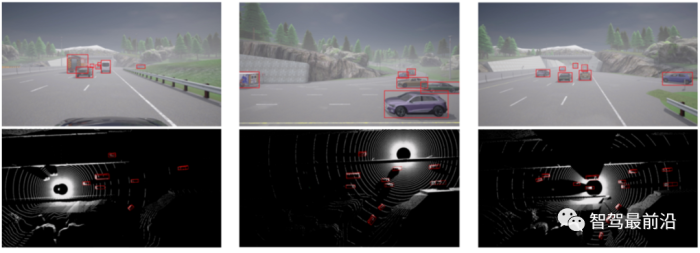

ADS感知层的第一个挑战是可感知目标距离的挑战。远距离(250-300米)目标感知任务对高速行驶AVs的安全响应速度是至关重要的。对3D目标识别等视觉任务可说,随着感知距离增加,抽取高密度特征的AI主干网络的计算复杂度会按照二次元速度增加,对算力需求也加速度增加。从图3的对比还可以看出,采用长距LIDAR可以提升感知距离,特征点可以覆盖更大的区域但更稀疏,同时也会产生”Centre Feature Missing(CFM)”即点云空心化或者叫黑洞的问题,极端场景包括近距离的超大车辆的中心特征缺失。解决CFM挑战问题的一般方法是在BEV特征空间依赖卷积操作通过特征发散来提供中心区域的感知场,或者通过点云中非空的区域来预测中间空心区目标,代价是目标预测误差和不确定性的输出结果,或者通过连通域打标签CCL进行Instance Point Group进行插值和滤波,以及整个点云的超分变率Super-Resolution来改善性能。

ADS感知层的第二个挑战是目标遮挡即感知盲区的挑战。单纯依赖AVs自身360全方位近距感知和远距感知,很难能够让ADS从理论上完全超越人类的驾驶水平,通过预测预警达到更低的交通事故率和提供更好的人身安全。如图4所示的对比案例,可以看出车路协同可以有效解决盲区与上述所说的长距感知的挑战,但对应的缺点也不言而喻,部署的成本与长期可靠运营费用以及如何防网络攻击问题,这决定了对乡村和偏远地区的场景,需要寻求AVs自身的多模感知认知决策能力提升。

如图5所示,V2X的可行解决方案包括交通要道部署的RSU Camera,LiDAR, 或者Radar,对算法设计来说,需要解决海量点云数据的压缩与实时传输,以及针对接收数据的时间轴同步,多模感知与特征融合目标识别等。目前这个领域基于Transformer在BEV空间进行多任务多模态的融合感知已经有了一些长足进展,融合的方式也可以自由组合,包括多视觉的Camera视频融合,以及 Camera与LiDAR或者Radar的组合融合模式,对点云数据的超分变率会改善融合效果,但融合对延迟非常敏感。

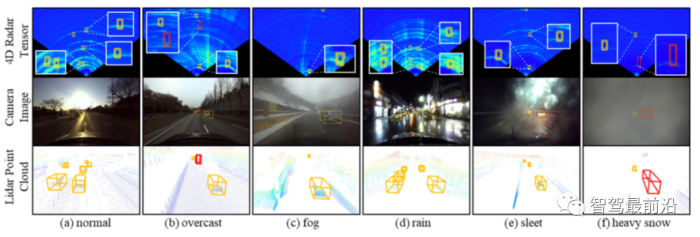

ADS感知层的第三个挑战是恶劣场景的挑战。如图6所示,4D 高清Radar发送的毫米波,可以有效穿越雨滴和雪花,不受低照与雨雪雾天气影响,但会受到多径干扰问题影响,总体来说对环境的适应性高,单独或者组合应用对2D/3D目标检测非常有优势,同时还可以提供高精度的目标高度和速度信息,可以有助于ADS的预测规划性能提升。

图 6. 4D Radar,Camera, LiDAR点云的3D目标检测识别对比案例 (Paek, 2022)

热点文章

-

冷却系统卡箍紧固力矩的确定方法与性能分析

2026-05-15

-

国轩高科以全场景技术突破铺就全产业链可持续发展基石

2026-05-15

-

白车身超声波无损检测质量管理体系构建与大数据应用研究

2026-05-19

-

基于尺寸链极值法的涂胶间隙问题优化

2026-05-21

-

基于多维度因素的螺栓装配拧紧断裂失效机理研究

2026-05-22

-

国轩高科集中发布七大新品!

2026-05-18

-

小米自动驾驶模型正式发布,并全面开源

2026-05-15

-

基于多维度因素的螺栓装配拧紧断裂失效机理研究

本文针对汽车尾门装配过程中铰链螺栓拧紧断裂失效问题,采用“人机料法环”多维分析方法,对10.9级M8螺栓、10级自锁螺母的失效案例展开系统性研究。研究结果表明,螺栓断裂均发生于接近36N·m目标扭矩的临界阶段,根本原因在于“料”(螺母低摩擦系数)与“法”(超限扭矩设计)的耦合作用,使螺栓承受的实际应力超过承载能力,而装配错孔产生的附加弯曲力进一步加剧断裂风险。该研究为汽车螺栓装配工艺优化提供了基于“人机料法环”体系的理论依据和实践指导,有助于从全流程维度提升装配可靠性。

作者:何林玥 邹尚博 郭东栋 刘少印

-

基于尺寸链极值法的涂胶间隙问题优化

-

白车身超声波无损检测质量管理体系构建与大数据应用研究

-

国轩高科以全场景技术突破铺就全产业链可持续发展基石

-

冷却系统卡箍紧固力矩的确定方法与性能分析

-

油泵啸叫的制造工艺溯源与齿轮微观精度控制研究

评论

加载更多