高精度地图:自动驾驶的向导

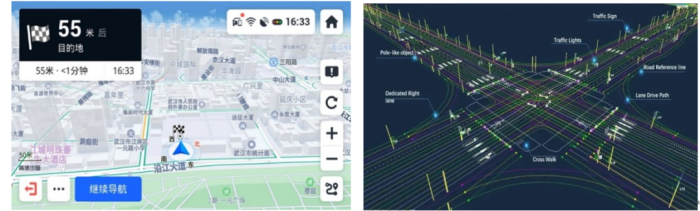

高精度地图是伴随着自动驾驶而生的,是目前研发L3及以上自动驾驶技术的标配。高精度地图是以厘米级精度来描述道路细节的数据集。与传统导航地图不同的是,高精度地图除了能提供的道路(Road)级别的导航信息外,还能够提供车道(Lane)级别的导航信息。无论是在信息的丰富度还是信息的精度方面,都远远高于传统导航地图。

图1 导航地图(左)与高精度地图(右)对比示意图

国内外高精度地图发展概述

高精度地图在自动驾驶中的作用主要体现在如下几个方面:

感知:红绿灯感知、车道线感知、超视距感知等大大简化了自动驾驶过程中后续预测以及规控算法设计的复杂度。

路径规划与决策:使用高精度地图提供的信息提前进行路径规划,同时根据障碍物所在车道位置或者红绿灯等信息预测障碍物可能的运行轨迹,从而提前做出预判和决策。

安全:在雨雪、大雾等极端天气下,各传感器可能会出现一定失效或者感知结果不准确,高精度地图可以有效的进行信息的补充,从而保证自动驾驶汽车行驶过程中的安全性,同时,在一些如多层立交、隧道等复杂的道路场景下,利用高精度地图,结合视觉毫米波雷达、激光雷达等无源定位的无源传感器,实现自主定位,这种融合定位的方式会大大提升定位的准确性,也会进一步提升自动驾驶的安全性。

高精度地图制作方案对比

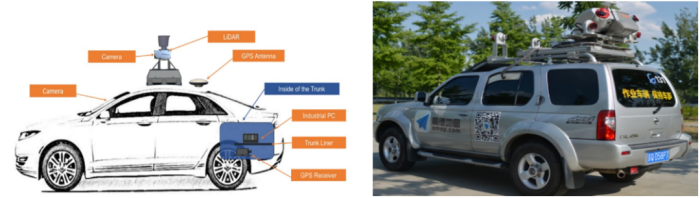

目前高精度地图的生产制作主要是两种方式,一种是采用摄像头这种纯视觉的生产方式,代表的公司Deep Motion、宽凳科技、Momenta等初创公司,纯视觉的生产方式除了大大降低生产成本,还会使得高精度地图制作的周期大大降低,加速高精度地图众包方案的落地,但是对算法技术的创新有较高的要求。另一种主流的方案是采用以激光雷达为主的高精地图采集方案来进行高精度地图的生产(图2为高精度地图采集车示意图以及实物图),代表公司有很多,例如Waymo、百度、四维图新、高德等,采用激光雷达为主,摄像头为辅的方案相对来说技术比较成熟,可以综合利用各个传感器的优势进行算法的研发,简化了后续算法研发的复杂度。但是生产制作成本高,生产周期长,同时不利于众包更新高精度地图方案的落地。

图2 高精度地图采集车示意图与实物图(从左到右)

高精度地图制作技术发展趋势

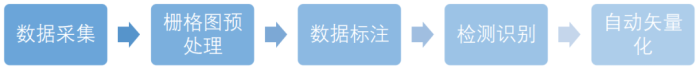

高精度地图可以分为两个层级:静态高精度地图和动态高精度地图。受限于芯片算力以及制作成本的考虑,目前的高精度地图制作都是围绕静态高精度地图展开的,其组成主要包括车道线信息、方向箭头信息、道路标志牌信息、道路属性信息等。在静态高精度地图图层之上,动态高精度地图主要包括道路上发生的实时动态信息,主要包括随时间变化的交通标志(如红绿灯状态、潮汐车道等)、道路交通信息(道路拥堵情况、事故发生情况、道路施工情况、交通管制情况、天气情况、路面积水情况等)。目前高精度地图的生成一般涉及到的技术为数据采集、栅格图预处理、数据标注、检测识别、自动矢量化等生产流程,如图3所示。

图3 高精度地图生产流程

数据采集技术:一般利用多传感器GPS、IMU、轮速计、激光雷达或者摄像头融合技术计算出当前采集车的位置信息,将该位置信息以及激光雷达/摄像头的扫描信息写入到地图数据中。

栅格图预处理:这里主要涉及点云拼接、栅格图融合以及伪影去除等。

数据标注:利用标注工具对需要识别的元素按照一定的规则进行标注。

检测识别:这里主要是利用深度学习算法进行检测和识别,提供目标元素的语义以及位置信息。

自动矢量化:按照一定的精度要求,给出利用点线以及多边形所描述目标物体的坐标信息。这里主要涉及数据采样、多边形拟合等传统图像数据处理算法。

可以看出整个流程还是相当繁琐的,同时制作成本也是相当高的。加上后期的地图更新和维护成本也会是相当复杂和价格高昂,这些都大大限制了其使用范围,尤其是在自动驾驶领域大规模的落地使用和更新。

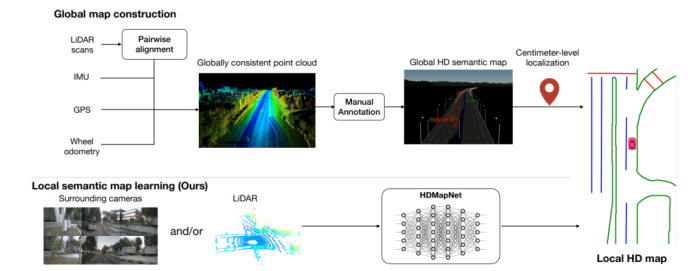

因此,为了解决在自动驾驶技术落地高精度地图使用的问题,产生了实时局部高精度地图生成的技术路线。相比较传统的高精度地图生成,该技术路线主要体现在高精度地图生成的实时性以及空间范围的局部性(只产生处在当前车辆周边环境的高精度地图信息以供自动驾驶使用)两个方面,如图4所示。

图4 传统高精度地图生产与实时局部高精度地图生产方式对比

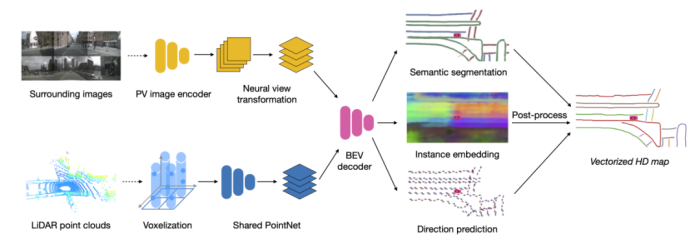

2021年,实时局部高精度地图技术路线主要是利用多视图摄像头/激光雷达采集到的图像数据利用神经网络进行特征提取并利用相机外参投影到鸟瞰图视角下,在鸟瞰图视角下进行解码操作得到车道线的分割信息以及车道线方向信息,在经过后处理操作得到矢量地图,如图5所示。

图5 在线局部高精度地图生成模型

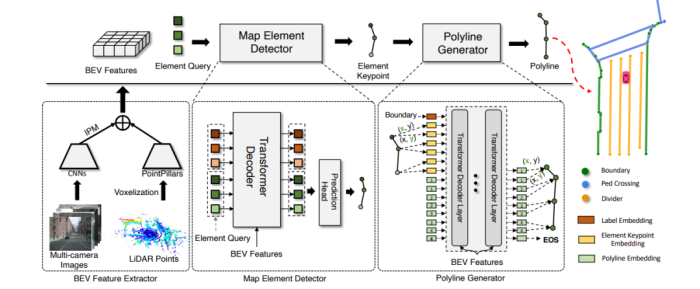

图6 VectorMapNet网络结构图

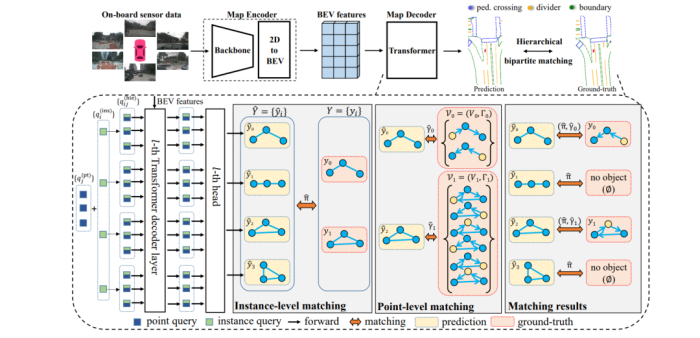

图7 MapTR网络结构图

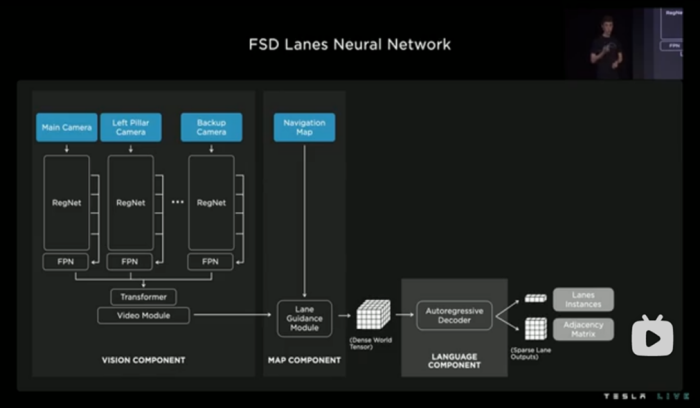

图8 Lanes Neural Network网络结构图

高精度地图制作技术发展趋势

从目前的技术发展路线来看,未来自动驾驶所需的高精度地图使用方式无论从制作成本、使用的便利性以后续更新的实时性角度考虑,很大概率会使用这种局部实时构建高精度地图的方式,感知数据输入会分为纯视觉(多视图)以及视觉与激光雷达融合输入的方案,但都是在鸟瞰图视角下利用transformer网络结构对多源数据(摄像头、激光雷达)进行感知特征的统一表征,同时为了提高车道线关键点之间拓扑结构关系描述的准确性以及更多的高精度地图元素输出,带有地图文本描述的信息会越来越多的加入到网络结构中,利用transformer网络结构将这些特征信息进行交互得到更准确的位置信息以及更多的高精度地图元素输出,而不局限于只有车道线、人行横道线等有关高精度地图线信息元素的矢量化输出。通过将视觉感知、文本、语音等不同模态数据,通过映射到同一语义空间进行特征对齐后,利用transformer网络结构进行特征交互学习得到统一的多模态特征,灵活的根据不同的下游任务进行特征解码操作也将是未来很多AI模型训练的一种方式。

焉知智能汽车

龚淑娟

李峥

热点文章

-

冷却系统卡箍紧固力矩的确定方法与性能分析

2026-05-15

-

国轩高科以全场景技术突破铺就全产业链可持续发展基石

2026-05-15

-

白车身超声波无损检测质量管理体系构建与大数据应用研究

2026-05-19

-

基于尺寸链极值法的涂胶间隙问题优化

2026-05-21

-

基于多维度因素的螺栓装配拧紧断裂失效机理研究

2026-05-22

-

国轩高科集中发布七大新品!

2026-05-18

-

小米自动驾驶模型正式发布,并全面开源

2026-05-15

-

基于多维度因素的螺栓装配拧紧断裂失效机理研究

本文针对汽车尾门装配过程中铰链螺栓拧紧断裂失效问题,采用“人机料法环”多维分析方法,对10.9级M8螺栓、10级自锁螺母的失效案例展开系统性研究。研究结果表明,螺栓断裂均发生于接近36N·m目标扭矩的临界阶段,根本原因在于“料”(螺母低摩擦系数)与“法”(超限扭矩设计)的耦合作用,使螺栓承受的实际应力超过承载能力,而装配错孔产生的附加弯曲力进一步加剧断裂风险。该研究为汽车螺栓装配工艺优化提供了基于“人机料法环”体系的理论依据和实践指导,有助于从全流程维度提升装配可靠性。

作者:何林玥 邹尚博 郭东栋 刘少印

-

基于尺寸链极值法的涂胶间隙问题优化

-

白车身超声波无损检测质量管理体系构建与大数据应用研究

-

国轩高科以全场景技术突破铺就全产业链可持续发展基石

-

冷却系统卡箍紧固力矩的确定方法与性能分析

-

油泵啸叫的制造工艺溯源与齿轮微观精度控制研究

评论

加载更多